香港理大突破 GenAI 三重核心制约 技术普惠化注入新动能

综合

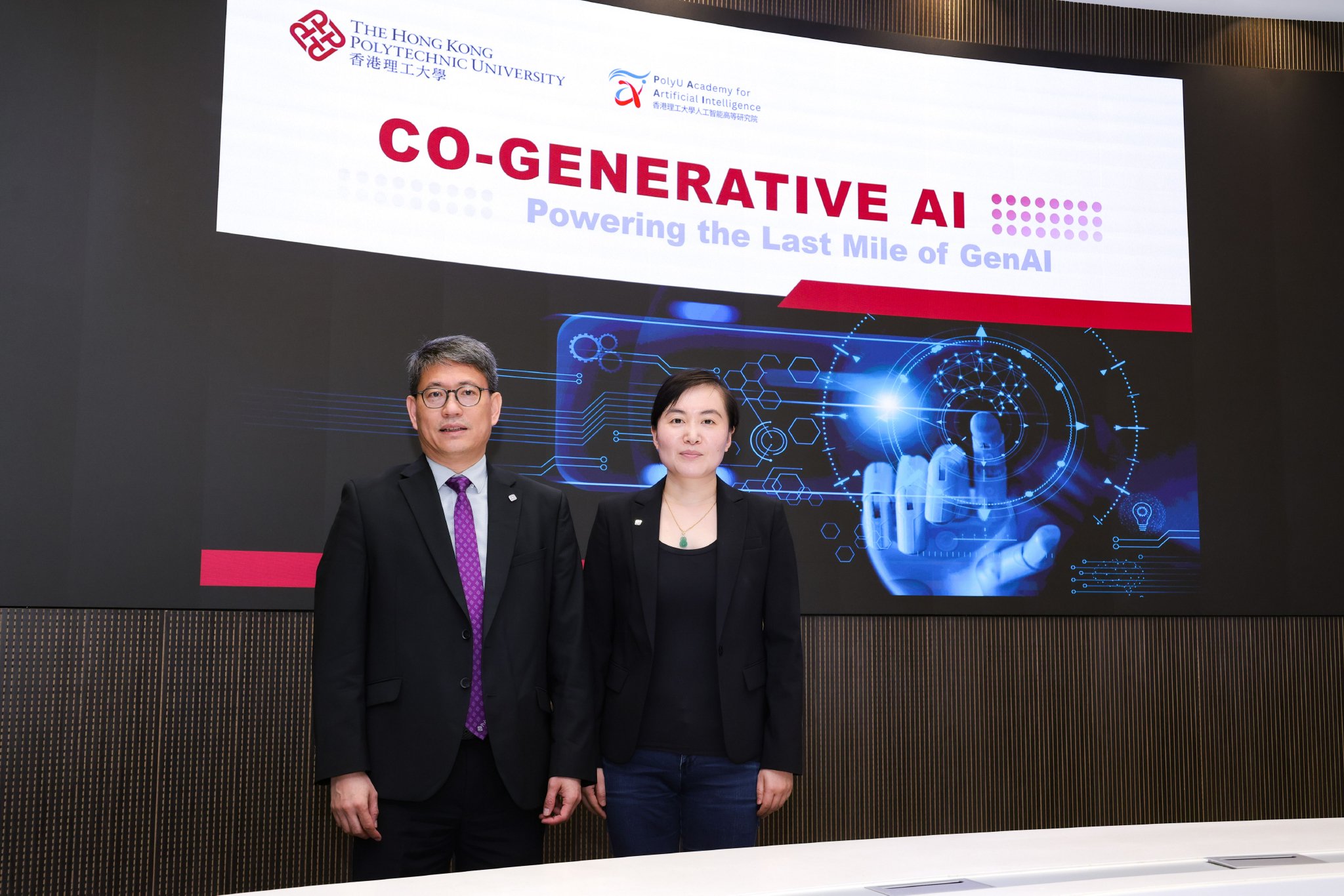

关注10 月 23 日,香港理工大学(下称 “理大”)人工智能高等研究院(PAAI)发布重磅成果 —— 在生成式人工智能(GenAI)领域攻克多项关键技术难题。团队首创 “协作式生成人工智能(Co-Generative AI)” 全新模式,成功将 AI 训练体系从传统集中式架构转型为分布式架构,在显著降低训练成本、强化数据隐私保护的同时,彻底打破行业资源垄断壁垒,为全球更多研究机构参与 AI 技术研发开辟新路径。

当前 GenAI 领域面临三大核心困境:其一,基础模型训练对计算资源需求极高,仅少数头部机构具备承担能力,导致学术界难以深度参与基础模型研发,各领域专属知识与数据也无法有效融入模型;其二,受隐私保护与版权归属限制,医疗、金融等领域的敏感数据难以投入模型训练;其三,基础模型更新知识难度大,每次重新训练均需消耗 “天文数字级” 资源,严重制约技术迭代速度。针对这些行业痛点,理大 PAAI 团队聚焦 “低成本训练” 与 “分布式融合” 两大方向开展技术攻关,最终取得突破性进展。

理大成为全球首个开源 “端到端 FP8 低比特训练全套方案” 的高校团队,成功打破当前基础模型普遍采用 BF16 精度训练的行业惯例,跻身全球掌握该核心技术的少数研究团队之列。相较于 BF16 精度训练,FP8 方案优势明显:训练效率提升超 20%,显存峰值占用降低逾 10%,训练成本大幅下降;同时整合 “持续预训练”“监督式微调” 与 “强化学习” 全流程,在保证训练效果与 BF16 模型相当的前提下,进一步压缩训练时间与显存占用。目前团队已启动更低成本的 FP4 精度训练研究,相关成果已发表于学术期刊;实测数据显示,该方案在医疗诊断推理领域性能超越当前业界同规模最优模型,在科研智能体(Research Agent)领域的任务处理复杂度、泛化能力及报告生成质量上,也实现重大突破。

传统基础模型遵循 “参数规模决定知识广度与性能强度” 的缩放定律,但其集中式训练模式需消耗百万计 GPU 小时,仅少数机构可实现。理大团队研发的 “InfiFusion 模型融合技术” 打破这一限制:仅需数百 GPU 小时,即可融合出传统模式下需 100 万至 200 万 GPU 小时训练的大模型。团队通过实例验证技术效率 —— 仅用 160 个 GPU 小时便完成 4 个尖端模型的融合工作,不仅省去单个尖端模型传统训练所需的百万计 GPU 小时成本,融合后的模型在多项权威测试中的性能,更显著优于原始模型。

此外,针对 Thinking Machines Lab 大力倡导的模型融合理念,理大团队首次从理论层面验证其可行性。研究团队通过严谨的数学推导,提出 “模型融合缩放定律(Model Merging Scaling Law)”,这一成果意味着,通往通用人工智能(AGI)的发展路径或可新增一条重要方向。理大 PAAI 执行院长、计算器及数学科学学院副院长(环球事务)兼电子计算学系教授杨红霞表示:“依托超低资源实现基础模型训练,结合高效模型融合技术,可让全球科研人员更便捷地参与 GenAI 研究,汇聚更多创新力量推动行业发展。”

在技术落地层面,理大团队已在多领域取得实质进展。医疗领域中,团队成功训练出性能领先的医疗基础大模型,并研发专属 “癌症 GenAI” 系统 —— 该系统在同规模模型中性能最优,可快速积累高质量医疗数据、直接对接医疗设备,为癌症个性化治疗规划提供支持。目前团队正联合复旦大学附属华山医院、中山大学肿瘤防治中心、山东省肿瘤医院及香港伊利沙伯医院,推进技术合作与临床落地工作。

团队在智能体 AI(Agentic AI)领域同样实现突破:该技术可作为研究生学术助手,辅助完成论文撰写与审阅工作;同时可作为多模态专利检索引擎,为创新研发提供高效支持,提升研发效率。

理大高级副校长(研究及创新)赵汝恒指出:“人工智能是加速培育新质生产力的核心驱动力,理大新成立的 PAAI 正全力推动人工智能技术与各重点领域的深度融合,并针对不同行业需求开发具备专业领域知识的 AI 模型。这一举措不仅能巩固理大在 AI 领域的领先地位,更将助力香港打造成为全球生成式人工智能发展枢纽。”

值得关注的是,杨红霞教授带领的研究项目,已先后获得研究资助局 “2025/26 年度主题研究计划”、香港特区政府创新科技署 “产学研 1 + 计划” 及数码港 “人工智能资助计划” 支持。这一系列资助不仅标志着香港在全球 AI 创新领域迈出坚实一步,更为 AI 技术的普惠化推广与产业落地注入新动能。杨教授提出在落地应用的选择上,挑选了医疗、能源等对人类影响重大且难度高的领域作为落地应用方向,不断测试结果。她表示要先把技术做到极高门槛,降低成本、提升质量,实现商业化落地,同时不脱离有挑战性的业务,稳扎稳打走好每一步。